31 najlepszych narzędzi do skrobania stron internetowych

Różne / / April 05, 2023

Dla osób, które nie są zaznajomione z kodowaniem, stworzenie narzędzia do skrobania stron internetowych może być trudne. Na szczęście oprogramowanie do skrobania stron internetowych jest dostępne zarówno dla programistów, jak i osób niebędących programistami. Oprogramowanie do skrobania stron internetowych to specjalnie zaprojektowane oprogramowanie do pozyskiwania odpowiednich danych ze stron internetowych. Narzędzia te są przydatne dla każdego, kto chce w jakiś sposób pozyskiwać dane z Internetu. Informacje te są zapisywane w lokalnym pliku na komputerze lub w bazie danych. Jest to technika samodzielnego zbierania danych dla sieci. Przedstawiamy listę 31 najlepszych darmowych narzędzi do skrobania stron internetowych.

Spis treści

- Ponad 30 najlepszych narzędzi do skrobania stron internetowych

- 1. Podchodzić

- 2. PareseHub

- 3. Apify

- 4. złom

- 5. FMiner

- 6. sekwencja

- 7. Agentura

- 8. Importuj.io

- 9. Webz.io

- 10. Drapieżnik

- 11. Skrobanie pszczoły

- 12. Jasne dane

- 13. Interfejs API skrobaka

- 14. Inteligentny Dexi

- 15. Diffbot

- 16. Streamer danych

- 17. Mozenda

- 18. Rozszerzenie Data Miner do przeglądarki Chrome

- 19. Zeskrobać

- 20. ScrapeHero Cloud

- 21. Skrobak danych

- 22. Visual Web Ripper

- 23. ośmiornica

- 24. Sieciowy Harvey

- 25. PySpider

- 26. Przechwytywacz treści

- 27. Kimurai

- 28. Cheerio

- 29. Lalkarz

- 30. Dramaturg

- 31. PJScrape

Ponad 30 najlepszych narzędzi do skrobania stron internetowych

Wybraną listę najlepszych narzędzi do skrobania stron internetowych można znaleźć tutaj. Ta lista zawiera zarówno narzędzia komercyjne, jak i narzędzia typu open source, a także linki do odpowiednich stron internetowych.

1. Podchodzić

Podchodzić to dodatek do przeglądarki Firefox, który można łatwo zainstalować ze sklepu z dodatkami do przeglądarki Firefox.

- To narzędzie do zbierania danych sprawia, że zbieranie kontaktów z Internetu i poczty e-mail jest dziecinnie proste.

- W zależności od wymagań będziesz mieć trzy możliwości zakupu tego produktu.

- Zawodowiec

- Ekspert, I

- Przedsiębiorstwo dostępne są edycje.

- Dokładne dane z witryn za pomocą Outwit Hub nie wymagają wiedzy programistycznej.

- Możesz rozpocząć przeglądanie setek stron internetowych jednym kliknięciem przycisku eksploracji.

2. PareseHub

ParseHub to kolejne z najlepszych darmowych narzędzi do skrobania stron internetowych.

- Przed pobraniem danych wyczyść tekst i HTML.

- To tak proste, jak wybranie danych, które chcesz wyodrębnić, za pomocą naszego zaawansowanego narzędzia do skrobania stron internetowych.

- Jest to jedno z najlepszych narzędzi do zbierania danych, ponieważ umożliwia przechowywanie zeskrobanych danych w dowolnym formacie do dalszej analizy.

- Przyjazny dla użytkownika interfejs graficzny

- To narzędzie do skrobania Internetu umożliwia automatyczne zbieranie i zapisywanie danych na serwerach.

Przeczytaj także: 16 najlepszych rozszerzeń blokujących reklamy dla Chrome

3. Apify

Apify to kolejne z najlepszych narzędzi do skrobania i automatyzacji sieci, które pozwala zbudować interfejs API dla dowolnej witryny, z wbudowanymi serwerami proxy dla domów i centrów danych, które ułatwiają ekstrakcję danych.

- Apify zajmuje się infrastrukturą i rozliczeniami, umożliwiając programistom zarabianie pasywnych pieniędzy, projektując narzędzia dla innych.

- Niektóre z dostępnych złączy to Zapier, Integromat, Keboola, I Airbyte.

- Apify Store ma gotowe rozwiązania do skrobania dla popularnych stron internetowych, takich jak Instagram, Facebook, Twitter i Google Maps.

- JSON, XML, CSV, HTML i Excel to ustrukturyzowane formularze, które można pobrać.

- HTTPS, kierowanie na geolokalizację, inteligentna rotacja adresów IP i GoogleSERP proxy to wszystkie funkcje Apify Proxy.

- Bezpłatny 30-dniowy okres próbny proxy z Kredyt na platformę w wysokości 5 USD.

4. złom

złom jest używany przez ponad 2000 firm i polegają one na tym unikalnym interfejsie API, który jest obsługiwany przez apilayer. Może Cię to również zainteresować, aby o tym przeczytać 25 najlepszych darmowych narzędzi indeksujących. Jest to jedno z najlepszych darmowych narzędzi do skrobania stron internetowych.

- Wykorzystuje ogólnoświatową pulę adresów IP obejmującą 35 milionów centrów danych.

- Umożliwia jednoczesne wykonanie wielu żądań API.

- Obydwa CAPTCHAdeszyfrowanie I JavaScript renderowanie jest obsługiwane.

- Dostępne są zarówno opcje bezpłatne, jak i płatne.

- Scrapestack to skrobanie online REST API który działa w czasie rzeczywistym.

- Interfejs API scrapestack umożliwia zdrapywanie stron internetowych w ciągu milisekund przy użyciu milionów adresów IP serwera proxy, przeglądarek i kodów CAPTCHA.

- Żądania skrobania sieci mogą być wysyłane z ponad 100 różnych lokalizacji na całym świecie.

5. FMiner

Dla systemów Windows i Mac OS, FMiner to popularny program do skrobania online, ekstrakcji danych, indeksowania ekranu, makr i obsługi sieci.

- Dane mogą być zbierane z trudnej do indeksowania dynamiki Sieć 2.0 strony internetowe.

- Umożliwia utworzenie projektu ekstrakcji danych za pomocą edytora wizualnego, który jest prosty w użyciu.

- Wykorzystuje kombinację struktur linków, menu rozwijanych i dopasowywania wzorców adresów URL, aby umożliwić przeglądanie stron internetowych.

- Możesz skorzystać z automatycznych usług decaptcha innych firm lub ręcznie wprowadzić dane do docelowej witryny CAPTCHA ochrona.

6. sekwencja

The sekwencja to solidne narzędzie Big Data do pozyskiwania wiarygodnych danych online. To kolejne z najlepszych darmowych narzędzi do skrobania stron internetowych.

- W porównaniu do rozwiązań alternatywnych, ekstrakcja danych online staje się coraz szybsza.

- Korzystając z tej funkcji, możesz przechodzić między wieloma platformami.

- Jest to jeden z najpotężniejszych skrobaków internetowych do rozwoju Twojej firmy. Zawiera proste funkcje, w tym wizualny edytor typu „wskaż i kliknij”.

- The dedykowane internetowe API pomoże Ci w tworzeniu aplikacji internetowych, umożliwiając uruchamianie danych internetowych bezpośrednio z Twojej witryny.

Przeczytaj także:Top 15 najlepszych darmowych odtwarzaczy IPTV

7. Agentura

Agentura to program do zbierania danych, ekstrakcji tekstu i OCR, który wykorzystuje Robotic Process Automation.

- Ten program umożliwia zmianę przeznaczenia wszystkich przetwarzanych danych do celów analitycznych.

- Możesz zbudować agenta za pomocą zaledwie kilku kliknięć myszką.

- Po zakończeniu zadania otrzymasz wiadomość e-mail.

- Pozwala łączyć się z Dropbox i używać bezpiecznego FTP.

- Wszystkie dzienniki aktywności dla wszystkich wystąpień są dostępne do zobaczenia.

- Pomaga w zwiększaniu sukcesu Twojej firmy.

- Umożliwia łatwe wdrażanie reguł biznesowych i niestandardowej logiki.

8. Importuj.io

Importując dane z określonej strony internetowej i eksportując dane do pliku CSV, import.io aplikacja do skrobania stron internetowych pomaga w tworzeniu zestawów danych. Jest to również jedno z najlepszych narzędzi do skrobania stron internetowych. Poniżej przedstawiono cechy tego narzędzia.

- Formularze internetowe/loginy są proste w użyciu.

- Jest to jedno z najlepszych rozwiązań do zbierania danych do wykorzystania Pszczoła i webhooki do integracji danych z aplikacjami.

- Możesz uzyskać wgląd w raporty, wykresy i wizualizacje.

- Ekstrakcję danych należy zaplanować z wyprzedzeniem.

- Chmura Import.io umożliwia przechowywanie i dostęp do danych.

- Interakcję z siecią i przepływy pracy można zautomatyzować.

9. Webz.io

Webz.io umożliwia indeksowanie setek stron internetowych i natychmiastowy dostęp do danych strukturalnych i danych w czasie rzeczywistym. Jest to również jedno z najlepszych darmowych narzędzi do skrobania stron internetowych.

Użytkownik może nabywać uporządkowane, nadające się do odczytu maszynowego zbiory danych w formatach JSON i XML.

- Daje dostęp do źródła historyczne które obejmują ponad dziesięć lat danych.

- Umożliwia dostęp do dużej bazy danych bez konieczności ponoszenia dodatkowych kosztów.

- Możesz użyć zaawansowanego filtra do przeprowadzać szczegółowe analizy i przesyłać zestawy danych.

Przeczytaj także:15 najlepszych bezpłatnych dostawców poczty e-mail dla małych firm

10. Drapieżnik

Zeskrob Sowa to platforma do skrobania stron internetowych, która jest łatwa w użyciu i ekonomiczna.

- Głównym celem Scrape Owl jest zeskrobywanie wszelkiego rodzaju danych, w tym e-commerce, ogłoszeń o pracę i ofert nieruchomości.

- Przed wyodrębnieniem materiału możesz uruchomić custom JavaScript.

- Możesz używać lokalizacji do obchodzenia lokalnych ograniczeń i uzyskiwania dostępu do lokalnych treści.

- Zapewnia niezawodną funkcję oczekiwania.

- Obsługiwane jest renderowanie JavaScript na całej stronie.

- Ta aplikacja może być używana bezpośrednio na Arkusz Google.

- Oferuje bezpłatną wersję próbną 1000 kredytów, aby wypróbować usługę przed zakupem jakichkolwiek członkostw. Nie ma potrzeby używania karty kredytowej.

11. Skrobanie pszczoły

Skrobanie pszczoły to web scraping API, który dba o ustawienia proxy i przeglądarki bezgłowe.

- Może wykonywać JavaScript na stronach i obracaj serwery proxy dla każdego żądania, dzięki czemu możesz czytać nieprzetworzony kod HTML bez umieszczania na czarnej liście.

- Dostępny jest również drugi interfejs API do wyodrębniania wyników wyszukiwania Google.

- Renderowanie JavaScript jest obsługiwane.

- Posiada funkcję automatycznej rotacji proxy.

- Ta aplikacja może być używana bezpośrednio na Arkusze Google.

- Do korzystania z programu wymagana jest przeglądarka internetowa Chrome.

- Jest idealny dla Amazonkaskrobanie.

- Pozwala zeskrobać wyniki Google.

12. Jasne dane

Jasne dane jest wiodącą na świecie internetową platformą danych, oferującą ekonomiczne rozwiązanie do gromadzenia i konwersji publicznych danych internetowych na dużą skalę z łatwością przekształcać dane nieustrukturyzowane w dane ustrukturyzowane i zapewniać klientom doskonałą obsługę przy zachowaniu pełnej przejrzystości i zgodny.

- Jest najbardziej elastyczny, ponieważ zawiera gotowe rozwiązania, można go rozbudowywać i dostosowywać.

- Nowa generacja Bright Data Zbieracz danych zapewnia zautomatyzowany i spersonalizowany przepływ danych na jednym dashboardzie, niezależnie od wielkości kolekcji.

- Jest otwarta 24 godziny na dobę, siedem dni w tygodniu i oferuje pomoc klientom.

- Z Handel elektronicznytrendy i dane z sieci społecznościowych do analizy konkurencji i badań rynkowych, zestawy danych są dostosowane do potrzeb Twojej firmy.

- Możesz skoncentrować się na swojej podstawowej działalności, automatyzując dostęp do wiarygodnych danych w swojej branży.

- Jest najbardziej wydajny, ponieważ wykorzystuje rozwiązania bez kodu i zużywa mniej zasobów.

- Najbardziej niezawodne, z najlepszą jakością danych, dłuższym czasem sprawności, szybszymi danymi i lepszą obsługą klienta.

13. Interfejs API skrobaka

Możesz skorzystać z Interfejs API skrobaka narzędzie do obsługi serwerów proxy, przeglądarek i CAPTCHA.

- Narzędzie zapewnia niezrównaną szybkość i niezawodność, pozwalając na tworzenie skalowalnych skrobaków sieciowych.

- Możesz uzyskać kod HTML z dowolnej strony internetowej za pomocą jednego wywołania interfejsu API.

- Konfiguracja jest prosta, ponieważ wszystko, co musisz zrobić, to wysłać żądanie GET ze swoim Klucz API I Adres URL do Punkt końcowy interfejsu API.

- Pozwala JavaScript łatwiej renderować.

- Pozwala dostosować typ żądania i nagłówki dla każdego żądania.

- Rotacyjne serwery proxy z lokalizacją geograficzną

Przeczytaj także:20 najlepszych aplikacji do śledzenia telefonów komórkowych

14. Inteligentny Dexi

Dexi inteligentny to aplikacja do skrobania online, która umożliwia przekształcenie dowolnej ilości danych internetowych w szybką wartość komercyjną.

- To narzędzie do skrobania online pozwala zaoszczędzić pieniądze i czas dla Twojej firmy.

- Zwiększyła wydajność, dokładność i jakość.

- Umożliwia najszybszą i najbardziej wydajną ekstrakcję danych.

- To ma system gromadzenia wiedzy na dużą skalę.

15. Diffbot

Diffbot umożliwia szybkie uzyskanie wielu ważnych faktów z Internetu.

- Dzięki ekstraktorom AI będziesz w stanie wyodrębnić dokładne dane strukturalne z dowolnego adresu URL.

- Nie zostaniesz obciążony kosztami czasochłonnego przeglądania stron internetowych ani ręcznych zapytań.

- Aby zbudować pełny i dokładny obraz każdego obiektu, wiele źródeł danych jest łączonych.

- Możesz wyodrębnić dane strukturalne z dowolnego Adres URL z Ekstraktory AI.

- Z Crawwlbot, możesz zwiększyć skalę wyodrębniania do dziesiątek tysięcy domen.

- The Graf wiedzy zapewnia sieci dokładne, pełne i głębokie dane, których BI potrzebuje do dostarczania wartościowych informacji.

16. Streamer danych

Streamer danych to technologia, która pozwala na pobieranie materiałów społecznościowych z całego internetu.

- Jest to jeden z największych skrobaków online, który wykorzystuje przetwarzanie języka naturalnego do pobierania kluczowych metadanych.

- Kibana I Wyszukiwanie elastyczne służą do zapewniania zintegrowanego wyszukiwania pełnotekstowego.

- Oparte na algorytmach wyszukiwania informacji, zintegrowanym usuwaniu szablonów i ekstrakcji treści.

- Zbudowany na infrastrukturze odpornej na awarie, aby zapewnić wysoką dostępność informacji.

Przeczytaj także:Jak zablokować i odblokować stronę internetową w Google Chrome

17. Mozenda

Możesz wyodrębnić tekst, zdjęcia i materiały PDF ze stron internetowych za pomocą Mozenda.

- Możesz użyć wybranego przez siebie narzędzia Bl lub bazy danych do gromadzenia i publikowania danych online.

- Jest to jedno z najlepszych narzędzi do skrobania online do organizowania i formatowania plików danych do publikacji.

- Dzięki interfejsowi typu „wskaż i kliknij” możesz w ciągu kilku minut utworzyć agentów do skrobania stron internetowych.

- Aby zbierać dane internetowe w czasie rzeczywistym, użyj Sekwencja pracy I Blokowanie żądańmożliwości.

- Zarządzanie kontem i obsługa klienta należą do najlepszych w branży.

18. Rozszerzenie Data Miner do przeglądarki Chrome

Skrobanie sieci i przechwytywanie danych jest łatwiejsze dzięki Wtyczka przeglądarki Data Miner.

- Ma możliwość indeksowania kilku stron, a także dynamicznej ekstrakcji danych.

- Selekcja danych może odbywać się na różne sposoby.

- Sprawdza informacje, które zostały zeskrobane.

- Pobrane dane można zapisać jako plik CSV.

- Pamięć lokalna służy do przechowywania zeskrobanych danych.

- Dodatek do Chrome Skrobak internetowy pobiera dane z dynamicznych witryn.

- it Mapy witryn można importować i eksportować.

Przeczytaj także:28 najlepszych programów do kopiowania plików dla systemu Windows

19. Zeskrobać

Zeskrobać jest również jednym z najlepszych narzędzi do skrobania stron internetowych. Jest to oparta na Pythonie platforma do skrobania online o otwartym kodzie źródłowym do tworzenia skrobaków internetowych.

- Zapewnia wszystkie narzędzia potrzebne do szybkiego wyodrębniania danych ze stron internetowych, analizowania ich i zapisywania w wybranej strukturze i formacie.

- To narzędzie do zbierania danych jest niezbędne, jeśli masz duży projekt zbierania danych i chcesz, aby był on tak wydajny, jak to tylko możliwe, przy jednoczesnym zachowaniu dużej elastyczności.

- Dane mogą być eksportowane jako JSON, CSV, Lub XML.

- Obsługiwane są systemy Linux, Mac OS X i Windows.

- Jest rozwijany w oparciu o technologię sieci asynchronicznych Twisted, która jest jedną z jego kluczowych cech.

- Scrapy wyróżnia się prostotą użytkowania, obszerną dokumentacją i aktywną społecznością.

20. ScrapeHero Cloud

ScrapeHero wykorzystał swoją wieloletnią wiedzę na temat indeksowania sieci i przekształcił ją w ekonomiczne i proste w użyciu, gotowe roboty indeksujące i interfejsy API do zbierania danych z witryn takich jak Amazon, Google, Walmart i innych.

- Roboty indeksujące ScrapeHero Cloud obejmują automatyczne obracanie serwerów proxy i opcję uruchamiania wielu robotów jednocześnie.

- Nie musisz pobierać ani uczyć się, jak korzystać z jakichkolwiek narzędzi do zbierania danych lub oprogramowania ScrapeHero Cloud.

- Roboty indeksujące ScrapeHero Cloud umożliwiają natychmiastowe pobieranie danych i eksportowanie ich JSON, CSV, Lub Przewyższać formaty.

- Klienci planu Free i Lite ScrapeHero Cloud otrzymują pomoc e-mail, podczas gdy wszystkie inne plany otrzymują usługę priorytetową.

- Roboty indeksujące ScrapeHero Cloud można również skonfigurować tak, aby spełniały określone wymagania klientów.

- Jest to skrobak internetowy oparty na przeglądarce, który działa z dowolną przeglądarką internetową.

- Nie potrzebujesz żadnej wiedzy programistycznej ani tworzenia scrapera; to tak proste, jak klikanie, kopiowanie i wklejanie!

Przeczytaj także:Napraw błąd JavaScript Discord podczas uruchamiania

21. Skrobak danych

Skrobak danych to bezpłatna aplikacja do skrobania online, która zgarnia dane z jednej strony internetowej i zapisuje je jako pliki CSV lub XSL.

- Jest to rozszerzenie przeglądarki, które konwertuje dane na zgrabny format tabelaryczny.

- Instalowanie Wtyczka Chrome wymaga użycia ww Google Chrome przeglądarka.

- Możesz zeskrobać 500 stron miesięcznie dzięki darmowej wersji; ale jeśli chcesz zeskrobać więcej stron, musisz przejść na jeden z drogich planów.

22. Visual Web Ripper

Visual Web Ripper to narzędzie do automatycznego zbierania danych ze stron internetowych.

- Struktury danych są zbierane ze stron internetowych lub wyników wyszukiwania za pomocą tego narzędzia.

- Możesz eksportować dane do CSV, XML, I Przewyższać plików i posiada przyjazny dla użytkownika interfejs.

- Może również zbierać dane z dynamicznych stron internetowych, takich jak te, które używają AJAX.

- Wystarczy skonfigurować kilka szablonów, a web scraper zajmie się resztą.

- Visual Web Ripper oferuje opcje planowania, a nawet wysyła wiadomość e-mail, jeśli projekt się nie powiedzie.

23. ośmiornica

ośmiornica to przyjazna dla użytkownika aplikacja do skrobania stron internetowych z interfejsem wizualnym. Jest to jedno z najlepszych darmowych narzędzi do skrobania stron internetowych. Poniżej przedstawiono cechy tego narzędzia.

- Jego interfejs typu „wskaż i kliknij” ułatwia wybieranie informacji, które chcesz zeskrobać ze strony internetowej. Octoparse może obsługiwać zarówno statyczne, jak i dynamiczne strony internetowe dzięki AJAX, JavaScript, pliki cookie i inne możliwości.

- Zaawansowane usługi chmurowe, które pozwalają na wydobywanie dużych ilości danych są już dostępne.

- Zeskrobane informacje można zapisać jako tekst, CSV, HTML, Lub XLSX akta.

- Darmowa wersja Octoparse pozwala na zbudowanie do 10 robotów; jednak płatne plany członkostwa obejmują takie funkcje, jak interfejs API i duża liczba anonimowych adresów IP proxy, co przyspieszy ekstrakcję i umożliwi pobieranie dużych ilości danych czas rzeczywisty.

Przeczytaj także:Spakuj lub rozpakuj pliki i foldery w systemie Windows 10

24. Sieciowy Harvey

WebHarvey's Visual Web Scraper ma wbudowaną przeglądarkę do zgarniania danych z witryn internetowych. Jest to również jedno z najlepszych narzędzi do skrobania stron internetowych. Oto kilka funkcji tego narzędzia.

- Oferuje interfejs typu „wskaż i kliknij”, który ułatwia wybieranie elementów.

- Ten skrobak ma tę zaletę, że nie wymaga pisania żadnego kodu.

- CSV, JSON, I XML pliki mogą być używane do zapisywania danych.

- Możliwe jest również zapisanie go w formacie SQLBaza danych. WebHarvey oferuje wielopoziomową funkcję skrobania kategorii, która może zbierać dane ze stron z listami, śledząc każdy poziom połączeń kategorii.

- Wyrażenia regularne mogą być używane z narzędziem do skrobania Internetu, co daje dodatkową swobodę.

- Możesz skonfigurować serwery proxy, aby ukryć swój adres IP podczas pobierania danych ze stron internetowych, co pozwala zachować pewien poziom prywatności.

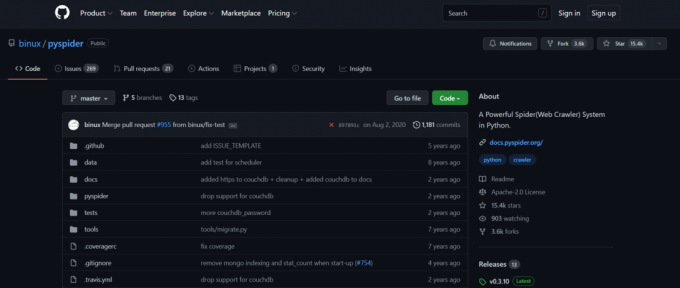

25. PySpider

PySpider jest również jednym z najlepszych darmowych narzędzi do skrobania stron internetowych, które jest robotem indeksującym opartym na Pythonie. Poniżej wymieniono kilka funkcji tego narzędzia.

- Posiada rozproszoną architekturę i obsługuje strony JavaScript.

- W ten sposób możesz mieć wiele robotów indeksujących. PySpider może przechowywać dane na dowolnym wybranym przez Ciebie zapleczu, w tym MongoDB, MySQL, Redis, i inni.

- Kolejki komunikatów, np KrólikMQ, Łodyga fasoli, I Redis są dostępne.

- Jedną z zalet PySpider jest jego prosty interfejs użytkownika, który pozwala zmieniać skrypty, monitorować bieżące działania i sprawdzać wyniki.

- Informacje można pobrać w formatach JSON i CSV.

- PySpider to narzędzie do skrobania Internetu, które należy wziąć pod uwagę, jeśli pracujesz z interfejsem użytkownika opartym na stronie internetowej.

- Działa również z witrynami, które używają dużo AJAX.

26. Przechwytywacz treści

Przechwytywacz treści to wizualne narzędzie do skrobania online z łatwym w użyciu interfejsem „wskaż i kliknij” do wybierania elementów. Poniżej przedstawiono cechy tego narzędzia.

- CSV, XLSX, JSON i PDF to formaty, w których można eksportować dane. Do korzystania z tego narzędzia wymagane są średniozaawansowane umiejętności programistyczne.

- Paginacja, nieograniczone przewijanie stron i wyskakujące okienka są możliwe dzięki interfejsowi użytkownika.

- Zawiera również AJAX/JavaScript przetwarzanie, rozwiązanie captcha, obsługa wyrażeń regularnych i rotacja adresów IP (za pomocą Nohodo).

Przeczytaj także:7-Zip vs WinZip vs WinRAR (najlepsze narzędzie do kompresji plików)

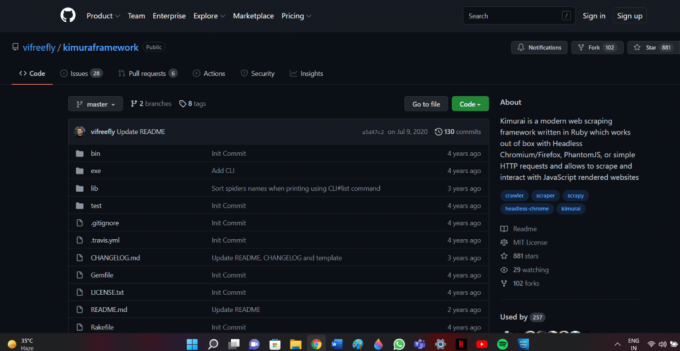

27. Kimurai

Kimurai to Ruby web scraping framework do tworzenia skrobaków i wydobywania danych. Jest to również jedno z najlepszych darmowych narzędzi do skrobania stron internetowych. Oto kilka funkcji tego narzędzia.

- Pozwala nam przeglądać i wchodzić w interakcje ze stronami internetowymi utworzonymi w JavaScript od razu po wyjęciu z pudełka Bezgłowy Chromium/Firefox, PhantomJS, Lub podstawowe zapytania HTTP.

- Ma podobną składnię do Scrapy i konfigurowalne opcje, w tym ustawianie opóźnienia, obracanie agentów użytkownika i domyślne nagłówki.

- Współpracuje również ze stronami internetowymi za pomocą Kapibara ramy testowe.

28. Cheerio

Cheerio to kolejne jedno z najlepszych narzędzi do skrobania stron internetowych. Jest to pakiet, który parsuje dokumenty HTML i XML oraz pozwala operować pobranymi danymi przy użyciu składni jQuery. Poniżej przedstawiono cechy tego narzędzia.

- Jeśli tworzysz skrobak sieciowy JavaScript, Cheerio API zapewnia szybki wybór do analizowania, modyfikowania i wyświetlania danych.

- Nie renderuje danych wyjściowych w przeglądarce internetowej, zastosuj CSS, załaduj zasoby zewnętrzne lub uruchom JavaScript.

- Jeśli którakolwiek z tych funkcji jest wymagana, powinieneś spojrzeć na PhantomJS Lub JSDom.

Przeczytaj także:Jak włączyć lub wyłączyć JavaScript w przeglądarce

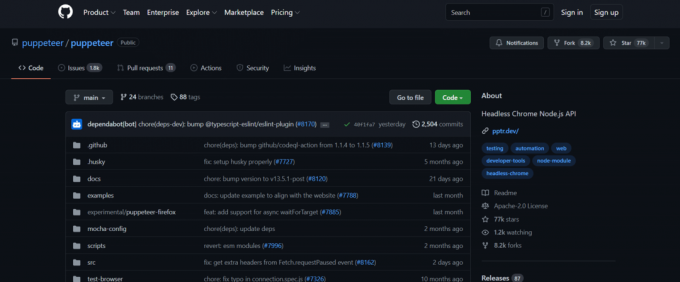

29. Lalkarz

Lalkarz to pakiet Node, który pozwala zarządzać bezgłową przeglądarką Google Chrome za pomocą potężnego, ale prostego interfejsu API. Poniżej wymieniono kilka funkcji tego narzędzia.

- Działa w tle, wykonując polecenia za pośrednictwem interfejsu API.

- Bezgłowa przeglądarka to taka, która może wysyłać i odbierać żądania, ale nie ma graficznego interfejsu użytkownika.

- Puppeteer jest właściwym rozwiązaniem do zadania, jeśli informacje, których szukasz, są generowane przy użyciu kombinacji Dane API I JavaScript kod.

- Możesz naśladować wrażenia użytkownika, pisząc i klikając w tych samych miejscach, co on.

- Puppeteer może być również używany do przechwytywania zrzutów ekranu stron internetowych, które są domyślnie wyświetlane po otwarciu przeglądarki internetowej.

30. Dramaturg

Dramaturg to biblioteka Microsoft Node przeznaczona do automatyzacji przeglądarek. To kolejne z najlepszych darmowych narzędzi do skrobania stron internetowych. Oto kilka funkcji tego narzędzia.

- Oferuje kompetentną, niezawodną i szybką automatyzację sieci w różnych przeglądarkach.

- Celem Playwright było usprawnienie zautomatyzowanego testowania interfejsu użytkownika poprzez usunięcie błędów, zwiększenie szybkości wykonywania i zapewnienie wglądu w działanie przeglądarki.

- Jest to nowoczesna aplikacja do automatyzacji przeglądarek, która pod wieloma względami jest porównywalna z Puppeteer i jest dostarczana z fabrycznie zainstalowanymi kompatybilnymi przeglądarkami.

- Jego główną zaletą jest kompatybilność z różnymi przeglądarkami, ponieważ może działać Chrom, WebKit, I Firefoxa.

- Dramaturg integruje się z Docker, Azure, Travis CI, I AppVeyor regularnie.

Przeczytaj także:Napraw uTorrent, który utknął podczas łączenia się z rówieśnikami

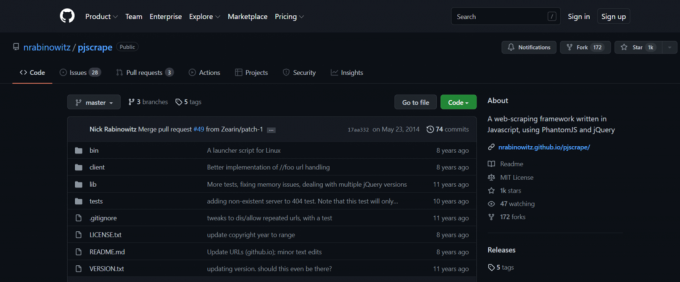

31. PJScrape

PJscrape to oparty na Pythonie zestaw narzędzi do skrobania online, który używa Javascript i JQuery. Poniżej przedstawiono cechy tego narzędzia.

- Został zaprojektowany do pracy z PhantomJS, więc możesz przeglądać strony z wiersza poleceń w pełni renderowanym kontekście obsługującym JavaScript, bez potrzeby korzystania z przeglądarki.

- Oznacza to, że możesz uzyskać dostęp nie tylko do DOM ale także zmienne i funkcje JavaScript, jak również Zawartość ładowana przez AJAX.

- Funkcje skrobaka są oceniane w kontekście całej przeglądarki.

Zalecana:

- Jak opróżnić kosz na Androida

- 28 najlepszych narzędzi do śledzenia błędów

- Top 32 najlepszych bezpiecznych witryn ROM

- 15 najlepszych klientów IRC dla komputerów Mac i Linux

Mamy nadzieję, że ten przewodnik był pomocny najlepsze narzędzia do skrobania stron internetowych. Daj nam znać, które narzędzie jest dla Ciebie łatwe. Odwiedzaj naszą stronę, aby uzyskać więcej fajnych wskazówek i wskazówek, i zostaw swoje komentarze poniżej.

Pete'a Mitchella

Pete jest starszym pisarzem w TechCult. Pete kocha technologię i jest zapalonym majsterkowiczem. Ma dziesięcioletnie doświadczenie w pisaniu poradników, funkcji i przewodników po technologiach w Internecie.